Vidi2 - 字节跳动开源的多模态视频理解与生成大模型

Vidi2是字节跳动开源的第二代多模态视频理解与生成大模型,专注于视频内容的理解、分析和创作。支持文本、视频、音频三种模态的联合输入,能同时理解画面内容、声音信息以及自然语言指令,实现跨模态的交互与推理。可精准定位视频中特定事件或目标对象的时间范围和空间位置,模型能自动标注出对应的时间段和画面中的目标区域,误差可精确到毫秒级。能处理数小时长的原始视频素材,快速检索出符合特定语义的片段。

Vidi2的功能特色

多模态处理能力:支持文本、视频、音频三种模态的联合输入,能够同时理解画面内容、声音信息以及自然语言指令,实现跨模态的交互与推理。

精细时空定位(STG):可精准定位视频中特定事件或目标对象的时间范围和空间位置,例如根据文本描述“某人在第X分钟做了某个动作”,模型能自动标注出对应的时间段和画面中的目标区域,误差可精确到毫秒级。

长视频理解与检索:能处理数小时长的原始视频素材,快速检索出符合特定语义的片段,即使视频内容复杂、场景切换频繁,也能保持较高的准确率。在超长视频(>1小时)场景下,性能领先主流商业模型。

视频问答与推理:支持基于视频内容的开放式问答,可回答关于剧情、角色关系、事件因果等问题,并通过多轮推理生成合理的答案,帮助用户快速获取视频中的关键信息。

智能剪辑与创作辅助:可自动提取高光片段、生成短视频标题,还能根据用户需求进行智能构图裁剪、自动多机位切换等操作,显著降低视频创作的门槛,提高创作效率。

Vidi2的核心优势

精细时空定位能力:Vidi2能同时识别视频中的时间戳和目标对象的边界框,给定文本查询,不仅能找到对应时间段,还能在这些时间范围内准确标记出具体物体的位置,实现以一秒粒度跟踪指定对象和人物,支持在人群中跟踪特定人物或在不连续镜头中分离道具等任务。

强大的视频理解与生成能力:Vidi2能处理数小时长的原始素材,理解其中的故事脉络,并根据简单提示生成完整的TikTok短视频或电影片段。

先进的技术架构:使用Gemma-3作为主干网络,并结合重新设计的自适应标记压缩技术,确保在处理长视频时保持效率而不丢失关键细节。此外,通过联合处理文本、视觉和音频来理解和创建视频,统一了跨模态的处理流程。

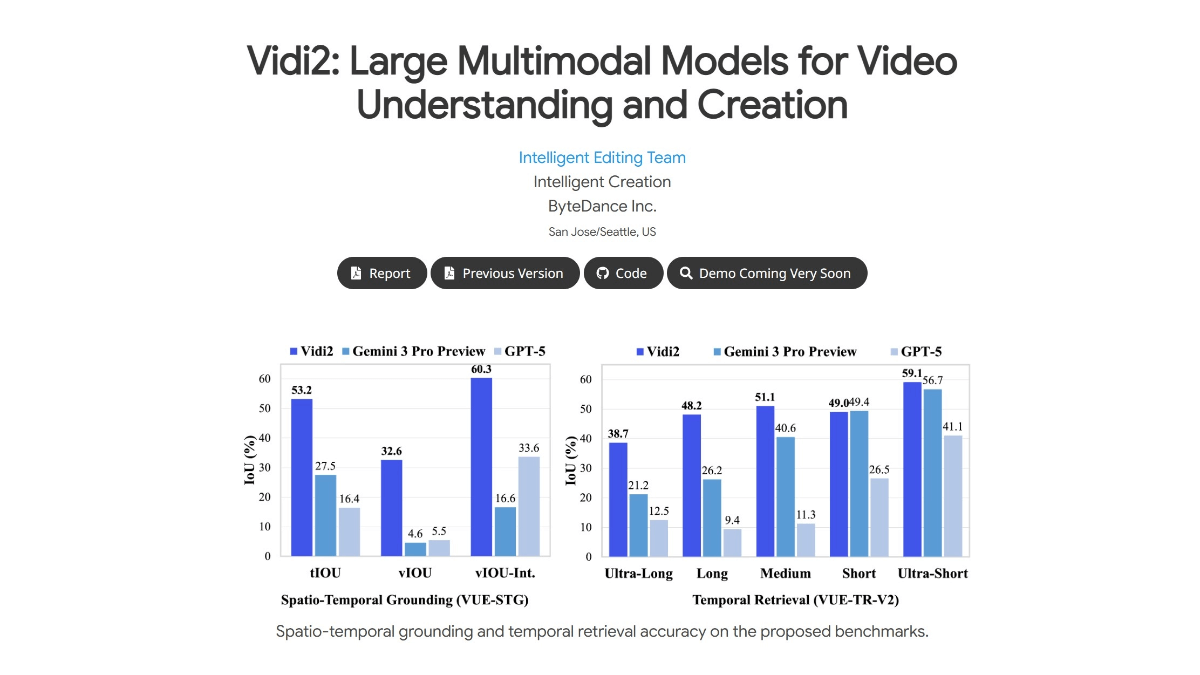

卓越的性能表现:在用于开放式时间检索的VUE-TR-V2基准上,Vidi2的总体IoU达到48.75,尤其在超长视频(超过1小时)上的表现比商业模型领先17.5个百分点。在定位任务(VUE-STG)上,Vidi2取得了vIoU32.57和tIoU53.19的最佳性能。

高效的数据训练策略:Vidi2的训练过程强调真实、多样化的视频数据,结合合成的定位数据和精心策划的标注,在大规模上对齐空间和时间推理。此外,还采用了时间感知多模态对齐策略(Temporal-aware Multimodal Alignment),通过分阶段、双向强化的训练机制提升模型的性能。

Vidi2官网是什么

项目官网:https://bytedance.github.io/vidi-website/

Github仓库:https://github.com/bytedance/vidi

arXiv技术论文:https://arxiv.org/pdf/2511.19529

Vidi2的适用人群

视频创作者:Vidi2能帮助视频创作者快速生成视频脚本、大纲和标题,能将长视频自动剪辑成适合平台发布的短视频,极大地提高了创作效率。

内容编辑团队:对于需要处理大量视频素材的编辑团队,Vidi2可以自动识别和提取视频中的关键片段,生成高光时刻,节省了人工筛选和剪辑的时间。

社交媒体运营者:Vidi2可以将长视频内容快速转化为适合社交媒体平台的短视频,帮助运营者更高效地发布内容,提升内容的传播效果。

影视制作人员:在影视后期制作中,Vidi2能辅助进行情节理解、镜头剪辑和字幕添加等工作,提升制作效率。

广告营销团队:Vidi2可以快速生成吸引人的视频内容,帮助广告团队制作更具吸引力的广告视频,提升广告效果。

教育工作者:教育工作者可以用Vidi2将教学视频进行优化处理,生成适合教学的短视频片段,提高教学资源的利用效率。