最近,Tyler Cowen,乔治梅森大学教授、硅谷最受欢迎的经济学家之一,在一次访谈中说:如果让 GPT-5 和我一起参加经济学考试,我会输。这句话暴露的,不是技术细节,而是 AI 和人类能力差距的真实处境:从“辅助工具”到“直接对手”的跨越。Cowen没有制造恐慌。他不关心“AI对齐”或“模型意识”这些热门话题。他关心更现实的问题:当 GPT-5 能考赢经济学教授,你的文凭还值钱吗?当 AI 能创作、写作、讲故事,你的创作还算人类专属吗?当大多数认知工作可被替代,什么才是真正的护城河?Cowen 的答案是:未来不会被替代的,不是有学历的人,而是“懂人”的人。这篇文章,我们跟随 Cowen 的视角,回答三个现实问题:人和 AI 差距有多大?会改变什么?我们怎么赢?

>>展开阅读

LongCat-Video是美团LongCat团队开源的13.6亿参数视频生成模型,采用MIT开源协议,支持文生视频、图生视频和视频续写三大任务。模型通过"粗到细"生成策略和块稀疏注意力机制,能在数分钟内生成720P高清长视频,保持色彩一致性且无质量衰减。技术亮点包括多奖励强化学习优化,性能接近商业级SOTA模型,在内部测试中多项指标超越同类开源模型。模型已在Hugging Face和GitHub开源,提供文本/图像输入、视频续写等一键式部署方案。

>>展开阅读

在美国发现大家聊得最多的不是大模型谁家最强,也不是哪家大模型炒股挣了多少钱,或者xxx融了多少钱,而是:GEO和GTM,都是流量,说明美国现在不缺AI产品点子,缺的是流量、曝光、声量、被看见的机会,以及,当然,增长。

>>展开阅读

>>展开阅读

上周,在 Dreamforce 2025 峰会,Anthropic 联合创始人兼 CEO Dario Amodei 说了一句引发广泛关注的话:我对短期内 AI 的互补性依然乐观,但我也必须坦白:两到五年内,真正的替代将开始出现。这不是科技行业第一次有人谈“AI 替代人类”。

>>展开阅读

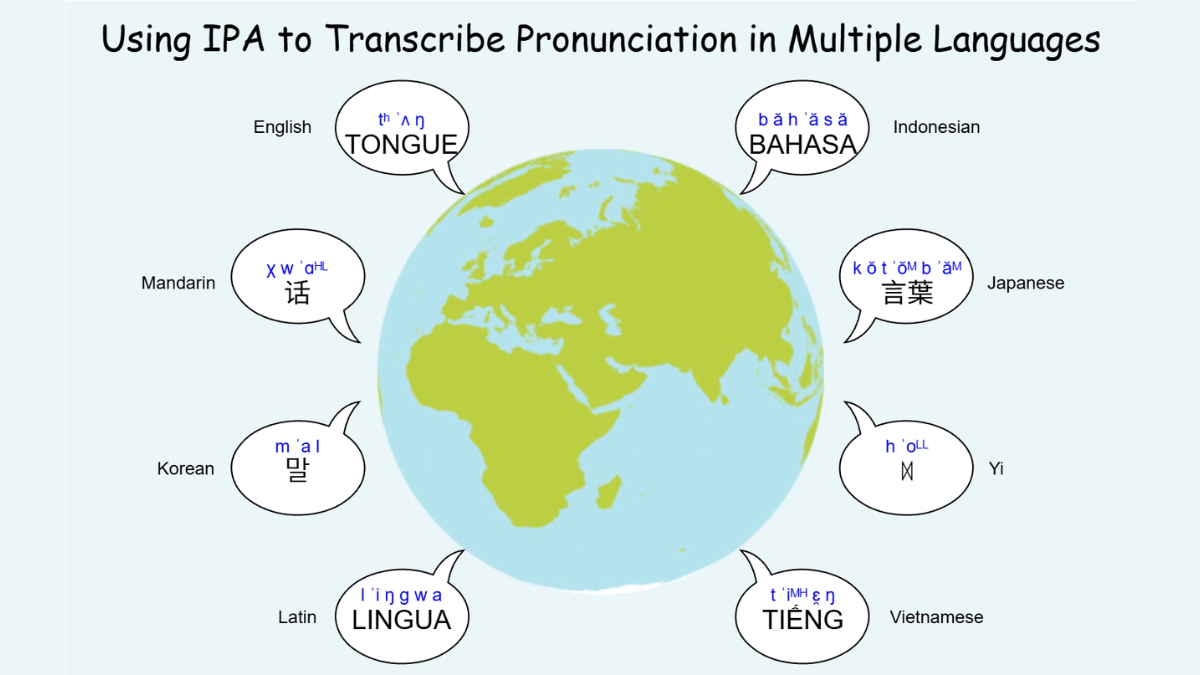

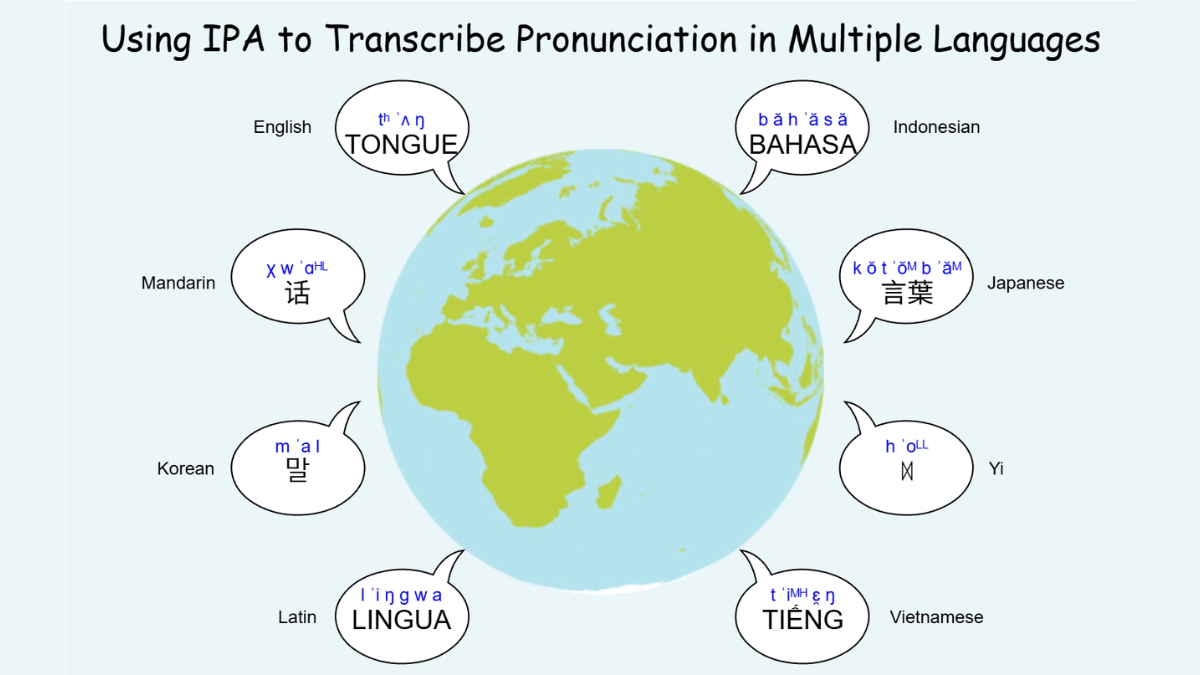

DiaMoE-TTS 是清华大学和巨人网络联合开源的多方言语音合成框架,基于国际音标(IPA),解决方言数据稀缺、正字法不一致和音系变化复杂等问题。通过统一的 IPA 前端标准化音素表示,消除跨方言差异,采用方言感知的 Mixture-of-Experts(MoE)架构,让不同专家网络专注于学习不同方言的特征,保留每种方言的独特音色和韵律。框架基于 F5-TTS 构建,引入低秩适配器(LoRA)和条件适配器,实现参数高效的方言迁移,仅需微调少量参数即可完成方言扩展。完全基于开源数据训练,无需昂贵的人工标注语音,降低了技术门槛。实验表明,DiaMoE-TTS 能生成自然且富有表现力的语音,在仅使用几小时数据的情况下,对未见方言和专业领域(如京剧)实现了零样本性能。DiaMoE-TTS 支持 11 种方言和普通话,可扩展到欧洲语言。

>>展开阅读

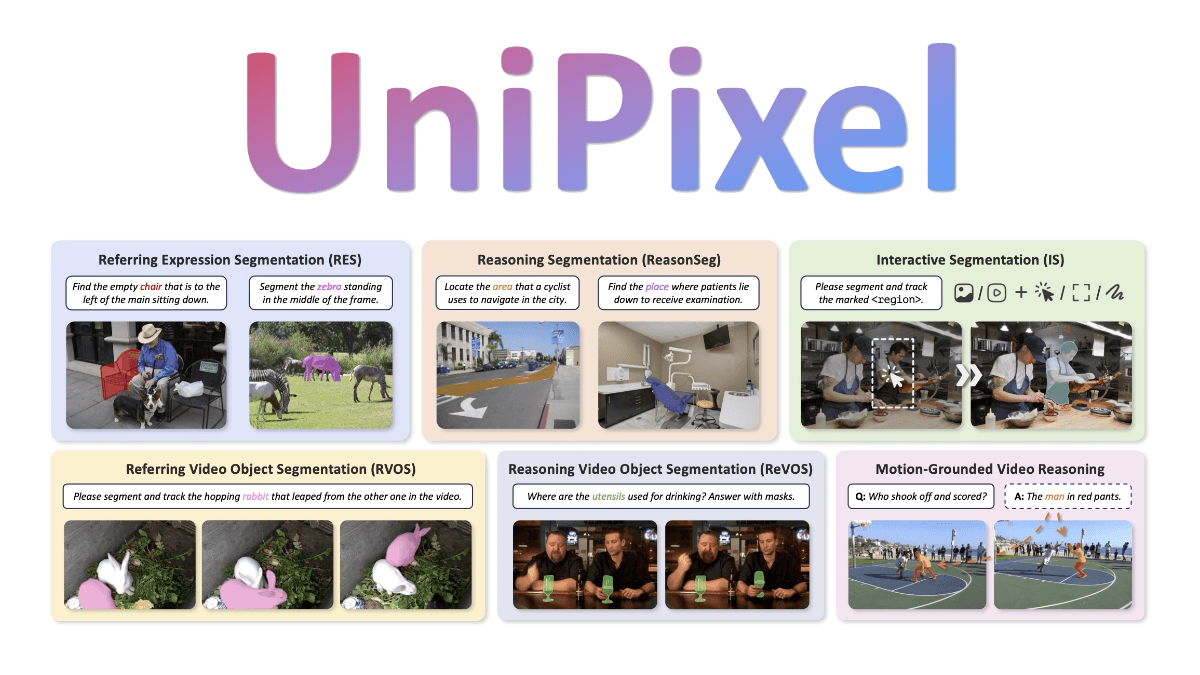

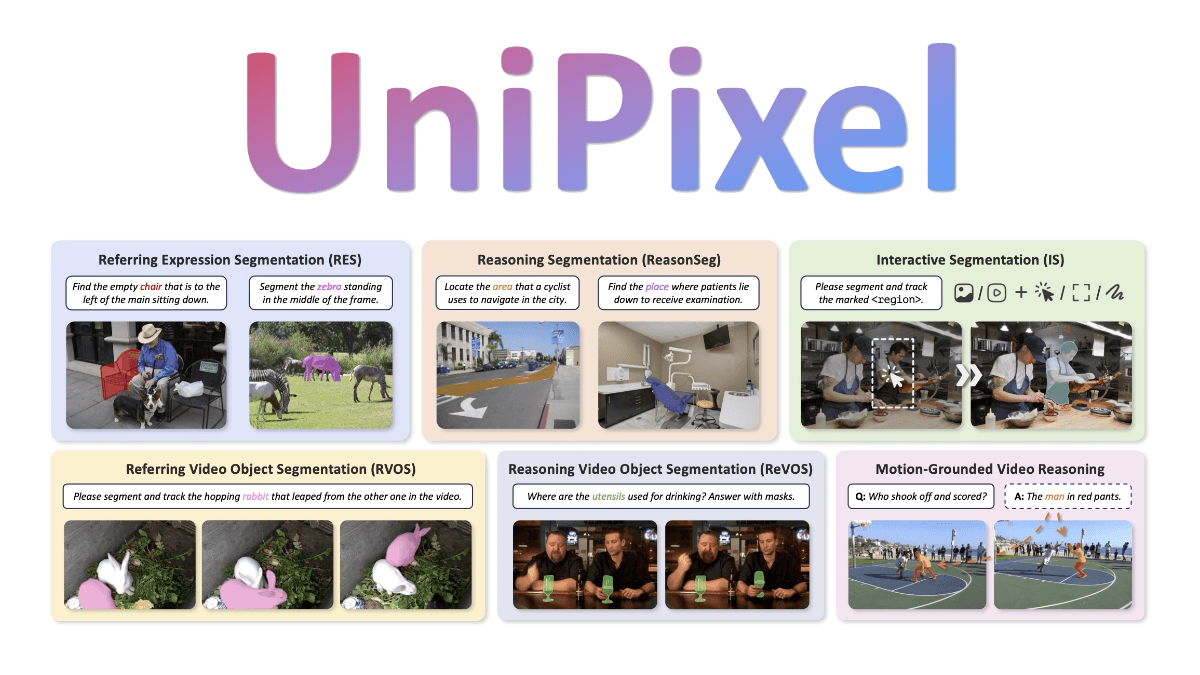

UniPixel是香港理工大学、腾讯、中国科学院和vivo等机构联合提出的新型多模态模型,实现像素级视觉语言理解。通过统一对象指代和分割能力,支持多种细粒度任务,如图像分割、视频分割、区域理解以及PixelQA任务。UniPixel的核心优势在于其强大的像素级推理能力,能根据语言描述生成精确的像素级掩码,实现语言与视觉的深度融合。在多个基准测试中,UniPixel表现出色,例如在ReVOS推理分割基准上,UniPixel-3B达到了62.1 J&F的高分,超越了现有所有模型。UniPixel提供了丰富的模型权重和数据集,支持灵活的硬件设置和高效的训练技术,为研究和应用提供了极大的便利。在智能监控、内容创作、教育、医疗影像分析和自动驾驶等领域的广泛应用前景。

>>展开阅读

对抗潮流是愚蠢的,唯一的出路是顺应并利用它。

>>展开阅读

- «

- 1

- ...

- 7

- 8

- 9

- 10

- 11

- 12

- 13

- ...

- 24

- »